Conheça os processadores EPYC Venice e Verano (Zen 6 e além) e os aceleradores Instinct MI400/MI500 (CDNA 5/6) que prometem redefinir o mercado de data centers e IA até 2027.

A Ascensão da AMD no Data Center

A AMD transformou radicalmente sua posição no mercado de data centers. De uma participação inferior a 1% em 2017, a empresa projeta alcançar quase 29% do mercado de CPUs para servidores até o final de 2025.

Com um crescimento exponencial, a AMD adota agora uma cadência anual de lançamentos para CPUs tradicionais e aceleradores de IA, visando expandir ainda mais sua influência.

Destaques do Roteiro para 2026 e 2027

Próximos 24 Meses: Inovações Cruciais

- 2026: CPU EPYC Venice (Zen 6, até 256 núcleos) e aceleradores Instinct MI400 (série AI e HPC), que impulsionarão a solução Helios de escala de rack para IA.

- 2027: Processador EPYC Verano e GPUs Instinct MI500 (série AI e HPC), base para o sistema de IA de próxima geração em escala de rack da empresa.

O lançamento de cerca de meia dúzia de designs de produtos importantes, incluindo CPUs especializadas e duas soluções de escala de rack, representa um avanço significativo para a AMD.

CPUs EPYC de Próxima Geração

EPYC Venice (Zen 6): Potência e Eficiência

- Microarquitetura: Zen 6.

- Processo de Fabricação: TSMC N2 (classe 2nm) – primeiro design de data center da AMD nesta tecnologia.

- Núcleos: Até 256 núcleos Zen 6 de alto desempenho (aumento de 33% em relação ao EPYC Turin).

- Form Factor: Novo SP7, permitindo mais dies de complexo de computação (CCDs), mais canais de memória e I/O aprimorado.

- Largura de Banda de Memória: Até 1,6 TB/s por soquete (mais que o dobro dos atuais 614 GB/s), provavelmente com suporte a módulos MR-DIMM ou MCR-DIMM.

- Conectividade com Aceleradores: Largura de banda CPU-para-GPU dobrada, provável adoção de PCIe 6.0 (128 GB/s bidirecionais por link).

- Desempenho: Reivindica até 70% mais desempenho em comparação com a série EPYC 9005 (cargas de trabalho não especificadas).

EPYC Venice-X: Cache Adicional para IA e HPC

A AMD indicou versões EPYC Venice-X com cache L3 adicional, destinadas a plataformas de IA soberana e HPC que utilizam aceleradores Instinct MI430X e MI440.

EPYC Verano (2027): O Futuro Pós-Zen 6

- Lançamento: 2027, para alimentar sistemas de IA de escala de rack de próxima geração.

- Arquitetura: Não confirmado se Zen 7 ou Zen 6+ com aprimoramentos significativos.

- Processo de Fabricação: Coincide com o processo de fabricação A16 da TSMC (produção em larga escala no final de 2026), que incorpora entrega de energia na parte traseira (backside power delivery) – crucial para CPUs de data center grandes e aceleradores de IA.

GPUs Instinct: Acelerando a IA e HPC

Série Instinct MI400 (CDNA 5): Soluções Adaptadas

Três produtos distintos baseados na arquitetura CDNA 5, otimizados para diferentes cargas de trabalho, visando eficiência, desempenho e custo-benefício.

- Instinct MI440X:

- Foco: Computação de IA de baixa precisão (FP4, FP8, BF16).

- Plataforma: Base da plataforma Enterprise AI da AMD (um EPYC Venice + oito MI440X).

- Uso: Implantações de IA locais para treinamento e inferência, compatível com infraestrutura de data center existente.

- Instinct MI455X: O Carro-Chefe para Performance Máxima

- Foco: Desempenho absoluto, para sistemas Helios de escala de rack.

- Refrigeração: Líquida.

- Desempenho: Projeção de 2X de desempenho, 50% mais capacidade de memória, 100%+ de largura de banda em comparação com MI355X. Atingirá 40 PFLOPS FP4 densos.

- Instinct MI430X: Para IA Soberana e HPC

- Foco: Ambientes de IA soberana e HPC.

- Precisão: Suporta FP32 e FP64 (necessário para computação técnica e supercomputação).

- Combinação: Usado com processadores EPYC Venice-X para cache extra e desempenho aprimorado de thread único.

Conectividade: Infinity Fabric e UALink

- Dentro do Pacote: Infinity Fabric para conectividade intra-pacote (MI430X, MI440X, MI455X).

- Escala: UALink para interconexão de aceleradores, com rumores de UALink-over-Ethernet.

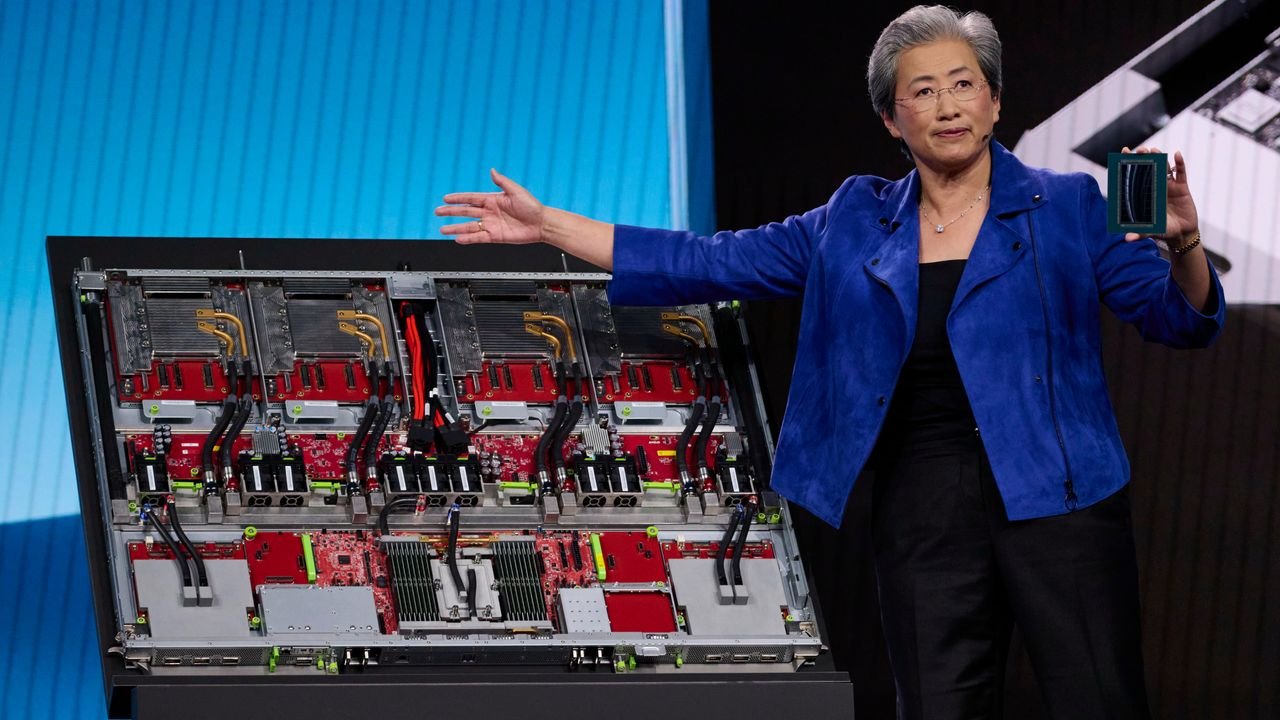

Helios: O Primeiro Sistema de IA em Escala de Rack da AMD

- Componentes: CPUs EPYC Venice, 72 aceleradores Instinct MI455X (interconectados via UALink/UALink-over-Ethernet).

- Memória: 31 TB de memória HBM4 com 1400 TB/s de largura de banda.

- Desempenho: 2900 PFLOPS FP4 densos.

- Rede: Placas de interface de rede (NICs) Pensando Vulcano 800 GbE (Ultra Ethernet).

- Disponibilidade: Rumores de atraso para o segundo trimestre de 2027, embora a AMD tenha negado. Possível disponibilidade exclusiva inicial para grandes clientes como Meta e OpenAI.

Série Instinct MI500 (CDNA 6): A Próxima Fronteira

Sistema de IA Mais Impressionante

- Aceleradores: Baseados na arquitetura CDNA 6.

- Lançamento: Final de 2027.

- Arquitetura do Sistema (MI500 UAL256):

- Três racks interconectados.

- Dois racks externos: 32 bandejas de computação (um EPYC Verano + quatro Instinct MI500).

- Rack central: 18 bandejas dedicadas a switches UALink.

- Total: 64 bandejas de computação e 256 módulos de GPU.

- Refrigeração: Líquida para bandejas de computação e hardware de rede.

- Comparação com Nvidia: Mais pacotes de GPU por sistema (78% mais que Nvidia Kyber VR300 NVL576), mas desempenho total ainda incerto.

O Futuro da AMD no Cenário da IA

Com a crescente receita proveniente de cargas de trabalho em data centers, a AMD busca manter a competitividade além de 2027, enfrentando futuras arquiteturas como a Feynman da Nvidia. A sólida base de produtos da AMD a posiciona bem na corrida pela IA.