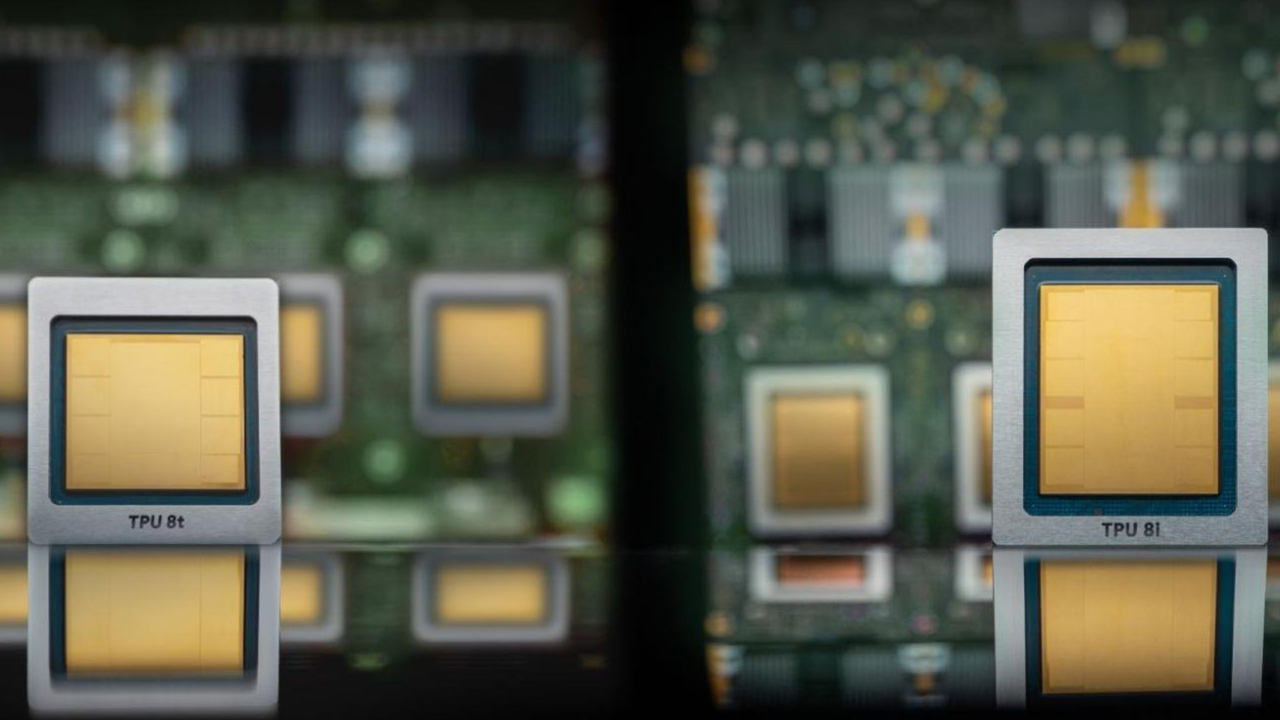

Conheça as novas unidades de processamento de tensor 8t e 8i, projetadas para treinamento massivo e inferência de baixa latência, superando desafios de desempenho através de arquitetura e parcerias estratégicas.

A Revolução Dupla dos Chips TPU V8 do Google

O Google anunciou suas Unidades de Processamento de Tensor de oitava geração (TPU V8) no Cloud Next em 22 de abril, introduzindo pela primeira vez dois designs de chip distintos em uma década.

- O TPU 8t é focado no treinamento de modelos em larga escala.

- O TPU 8i é otimizado para inferência de baixa latência e cargas de trabalho de raciocínio.

Cadeia de Suprimentos e Fabricação

A estratégia de divisão estende-se à cadeia de suprimentos:

- A MediaTek junta-se à Broadcom como parceira de design de silício, encerrando o papel exclusivo da Broadcom desde 2015.

- Ambos os chips são fabricados no processo TSMC N3 com memória HBM3E.

- Estarão disponíveis para clientes Google Cloud ainda este ano.

Especificações e Comparativo de Desempenho

Em termos de especificações brutas, o TPU 8 ainda não alcança a Nvidia ou AMD em desempenho por soquete.

- TPU 8t: 12.6 FP4 PFLOPs, 216 GB HBM3e (6.528 GB/s).

- TPU 8i: 10.1 FP4 PFLOPs, 288 GB HBM3e (8.601 GB/s), 384 MB SRAM.

- Comparativo: Nvidia R200 (35 FP4 PFLOPs) e AMD MI455X (40 FP4 PFLOPs) ainda lideram, com uma lacuna de aproximadamente 3:1 em poder de computação por soquete.

Estratégia do HBM3E: Custo vs. Desempenho

A escolha do HBM3E em vez do HBM4 sugere um equilíbrio deliberado entre custo e rendimento. O TPU 8t tem mais capacidade de memória que a geração anterior, mas menor largura de banda, visando reduzir custos por chip. O Google foca em oferecer alternativas e escalabilidade, e não apenas competir em desempenho bruto por chip.

Superpod TPU 8t e Escala Massiva

O Google aposta na escala para superar a concorrência:

- Um Superpod TPU 8t integra 9.600 chips em um único cluster, com dois petabytes de HBM compartilhado.

- Google afirma 121 FP4 ExaFLOPs de um único superpod.

- A nova rede Virgo Network pode conectar até 134.000 chips TPU 8t em uma única estrutura de data center, estendendo-se para mais de 1 milhão de chips em vários locais.

- Google tem vantagem na escala de pod, onde cargas de trabalho de treinamento utilizam milhares de aceleradores, superando o limite da Nvidia de 576 aceleradores em uma única implantação NVLink.

Arquitetura Inovadora do TPU 8i: Boardfly

A arquitetura do TPU 8i é uma partida radical da norma, abandonando a interconexão 3D Torus em favor da nova topologia “Boardfly”.

- A Boardfly é uma hierarquia de três camadas, inspirada no artigo Dragonfly.

- Reduz o diâmetro da rede em 56% (de 16 para 7 saltos), beneficiando diretamente modelos “Mixture-of-Experts” (MoE) que exigem comunicação all-to-all.

- O TPU 8i introduz o Collectives Acceleration Engine (CAE), substituindo o SparseCore para reduzir latência em operações de decoding em até cinco vezes.

- Com SRAM triplicada, otimiza a inferência de longo contexto, oferecendo 80% melhor desempenho por dólar em modelos MoE de baixa latência.

Recursos Avançados do TPU 8t

O TPU 8t mantém o 3D Torus e SparseCore para padrões de acesso de memória irregulares.

- Introduz computação FP4 nativa para dobrar o throughput em precisão reduzida.

- Um novo caminho TPUDirect RDMA que ignora a CPU do host para acesso dez vezes mais rápido ao armazenamento de alta velocidade.

- Ambos os chips operam em hosts CPU Axion (baseados em Arm) do Google, substituindo x86 pela primeira vez.

Parcerias Estratégicas e Clientes Chave

As parcerias e compromissos demonstram a força do programa TPU:

- A parceria com MediaTek (TPU 8i) e Broadcom (TPU 8t) pode reduzir o custo por chip em até 30%.

- Compromisso de capacidade de 3.5 GW com a Anthropic a partir de 2027.

- Meta assinou um acordo multianual para aluguel de 500.000 a 800.000 chips TPU até 2027.

- Apple está direcionando cargas de trabalho da Siri (com Gemini) para a infraestrutura TPU do Google Cloud, estimado em US$ 1 bilhão/ano.